La muerte de George Floyd ocurrió el 25 de mayo de 2020 en el vecindario de Powderhorn, en la ciudad estadounidense de Mineápolis, como resultado de su arresto por parte de cuatro policías locales. Desde entonces, la nación del norte de América ha estado en el ojo del huracán, debido a que el hecho reavivó la lucha del movimiento internacional Black Lives Matter.

A partir de la muerte del afroestadounidense las protestas se extendieron a otras ciudades del mundo y, recientemente, ha sido el detonante para que las empresas y los programadores tecnológicos reexaminen cómo se usan algunos términos técnicos en medio de las protestas de Black Lives Matter, específicamente, las palabras maestro y esclavo, que se usan generalmente como referencia a situaciones en las que un proceso o entidad controla a otro.

La batalla en el contexto tecnológico cobra vida dado que, según las estadísticas, desde 1976 Estados Unidos ha emitido más de 67.000 patentes utilizando dichos términos, desde un sistema de antena hasta un método de codificación de datos.

Si bien el movimiento comenzó en 2013 con el uso del hashtag #BlackLivesMatter en las redes sociales, después de la absolución de George Zimmerman por la muerte del adolescente afroamericano Trayvon Martin a causa de un disparo, ahora Black Lives Matter está provocando un renovado escrutinio de la diversidad y la equidad en la tecnología, incluido su vocabulario.

La discusión

Más allá de las bondades de la Inteligencia Artificial, del Internet de las cosas, poco se habla a nivel masivo de las discusiones éticas que rodean las tecnologías emergentes. Sin embargo, la discusión se da en casos reales del entorno virtual no tangible.

Y a medida que más organizaciones reexaminan su idioma, los codificadores de algunas empresas tecnológicas muestran interés en esta lucha y se involucran cada vez más en intensos debates sobre el grado en que estas palabras importan.

En 2016, Ferose V.R., vicepresidente mundial de Servicios de Globalización de SAP, uno de los mayores fabricantes de software del mundo, afirmaba que cuando se pretende hacer difusión tecnológica no solo se debe tener una visión enfocada en las regulaciones de cada país, sino también en sus culturas.

“Se deben hacer esfuerzos en la traducción de los sistemas. Yo soy de la India, donde tenemos 22 idiomas. Ahí hay un reto gigante para reducir brechas, pero en el resto del mundo también. Hay que buscar acciones para humanizar la tecnología”, declaraba.

Y advertía que si la tecnología empleaba atributos sensibles como el color de piel, la raza, el género, la edad, o el nivel socioeconómico, este problema es y sería discutible desde el punto de vista ético.

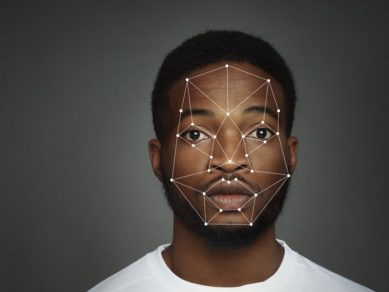

Otros especialistas sostienen que los sesgos presentes en los datos con que se entrenan los algoritmos hacen que la Inteligencia Artificial replique y maximice el racismo humano.

Evidentemente, el racismo no es exclusivo del plano físico del ser humano, sino que se ha extendido y amplificado a través de la tecnología, pues la potencia de cómputo ha permitido la democratización de la tecnología, abriendo espacios para el debate ético sobre cómo los algoritmos podían perpetuar los estereotipos raciales ha ido cobrando fuerza.

Incluso, organizaciones internacionales como la ONU o la Unión Europea han planteado guías para evitar que se sucedan estos sesgos y hacer rendir cuentas a los humanos que están detrás de estos sistemas, especialmente cuando su aparición implica decisiones que afectan directa y negativamente a la vida de algunos colectivos.

Hombre blanco

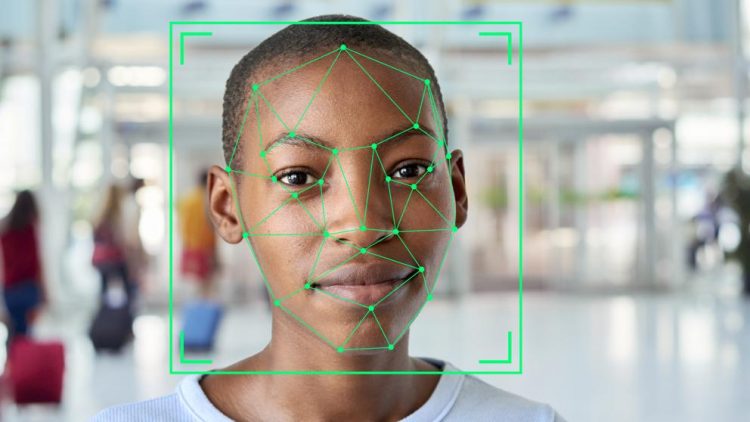

Las tecnologías de empresas privadas también han tenido episodios notables de discriminación hacia las personas que no encajan en el clásico baremo de «hombre blanco».

En una situación anecdótica y desagradable, la multinacional Google tuvo que pedir disculpas en 2015 tras demostrarse que su algoritmo de identificación de imágenes (usado en la app móvil Fotos) reconocía a personas negras como «gorilas».

En 2017, la Google Cloud Natural Language API realizaba análisis de sentimiento racistas de forma sistemática. Así, por ejemplo, las frases «soy negro» o «soy un judío» eran consideradas más negativas que «supremacía blanca», la cual Google consideraba como neutral. Lo mismo ocurrió con la orientación sexual («heterosexual» estaba mejor valorado que «homosexual»).

En contra parte, algunas organizaciones han revisado recientemente el lenguaje que podría verse arraigado en el racismo. Por ejemplo, la plataforma de desarrollo web de Django cambió de maestro y esclavo a líder y seguidor en 2014.

Si bien el lenguaje de programación Python cayó tanto maestro como esclavo en 2018, también generó cierta controversia entre los usuarios.

El mes pasado, la compañía de gestión de datos Delphix organizó un hackathon para que los empleados hicieran que la terminología de codificación en la compañía fuera más inclusiva. Los ingenieros adaptaron los reemplazos de maestro / esclavo a contextos específicos.

En medio de esta lucha y las distintas iniciativas anti racismo cabe preguntar cuántas empresas están dispuestas a examinar y mejorar el uso de términos cuyo significado lleva una carga simbólica y discriminatoria.